Gemma 4: как Google сделал флагманскую модель доступной для Raspberry Pi

Google представила Gemma 4 — семейство открытых моделей, работающих на дешёвых устройствах. Модель E2B с 2,3 миллиарда параметров запускается на Raspberry Pi 5, обрабатывает речь и видео без облака, а лицензия Apache 2.0 позволяет использовать её в коммерческих продуктах без отчислений. Но за досту…

Gemma 4: как Google открыл флагманскую модель, которую можно запустить на Raspberry Pi

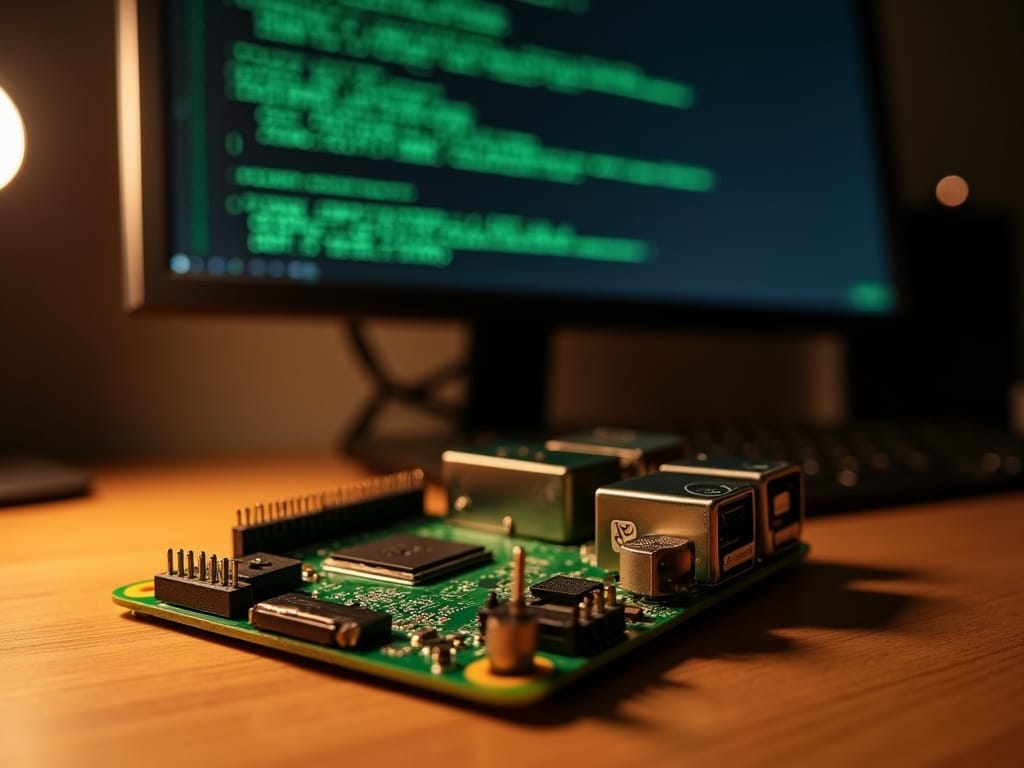

На столе лежит Raspberry Pi 5, к которому подключён микрофон. Через три минуты после воспроизведения тридцатисекундной записи медицинской консультации на экране появляется текст: модель Google Gemma 4 E2B с 2,3 миллиарда эффективных параметров распознала речь, структурировала вывод, выделила ключевые термины и сохранила результат в JSON. Весь цикл занял 2,5 гигабайта оперативной памяти и семь с половиной секунд на каждый декодированный токен.

Для интерактивного общения такая скорость мала, зато устройство работает без подключения к сети, не отправляет данные в облако и не требует лицензионных отчислений — и это не гипотетическая демонстрация. Именно Gemma 4 E2B, а не урезанная версия, помещается в 1,5 гигабайта при 2-битной квантизации и запускается на плате за семьдесят долларов. На том же «малинке» префиксная часть модели выдаёт 133 токена в секунду, а флагманская 31B Dense требует уже сорока и более гигабайт видеопамяти — порог, за которым оборудование перестаёт быть массовым.

Главный эффект релиза не в бенчмарках. Apache 2.0 снимает все коммерческие ограничения: можно модифицировать код, встраивать в проприетарные продукты, продавать конечные решения без отчислений Google. Для разработчиков, строящих закрытые системы или избегающих зависимости от зарубежных SaaS, это важнее, чем прирост в 15 процентных пунктов на MMLU Pro. Пока конкуренты оборачивают открытые модели в лицензии с оговорками, Google напрямую атакует их слабое место — возможность легально применять ИИ внутри своей инфраструктуры без юридических рисков.

Мультимодальность заявлена уже на уровне малых моделей. E2B и E4B принимают не только текст, но и аудио через встроенный конформер USM — тот же самый движок, что используется в Gemma 3n для распознавания речи. Видео же работает иначе: 26B MoE и 31B Dense поддерживают ролики до 60 секунд, но только на одном кадре в секунду. Длинные контекстные окна до 256 тысяч токенов обещают долгую память, однако на практике видео в таком формате превращается в набор ключевых кадров, а не в полноценный анализ сцены.

Аппаратную экономию обеспечивают два механизма. Per-Layer Embeddings добавляют вторичный путь погружения на каждый слой, не увеличивая активных параметров. Shared KV cache позволяет переиспользовать состояния ключ-значение в верхних слоях, сокращая расход памяти при длинных контекстах. В сумме это даёт 26B MoE с 3,8 миллиардами активных параметров — показатели, которые ещё год назад считались прерогативой моделей в сто и более миллиардов.

Агентные возможности выходят за рамки классических чат-ботов. В Gemma 4 интегрированы нативный вызов функций, гарантированный вывод в формате JSON и детектирование bounding box для элементов интерфейса. В документации Google приводит пример: модель получает скриншот приложения, сама вычисляет координаты кнопки и генерирует код для её нажатия. Для автоматизации UI это шаг вперёд, но надёжность таких цепочек всё ещё зависит от качества генерации и внешних сервисов, к которым обращается модель.

Остаётся один пробел, который Google не закрывает. Apache 2.0 разрешает всё необходимое для коммерческого использования, но ни слова не сказано о составе обучающих данных. В отличие от открытых моделей вроде OLMo или Pythia, где датасеты задокументированы, здесь пользователь не может ни воспроизвести тренировку, ни проверить влияние данных на качество. Для предприятий, которым важнее скорость внедрения, это допустимая жертва. Для исследователей — повод усомниться в воспроизводимости.

Что меняется для тех, кто не хочет зависеть от закрытых API? Выбор больше не сводится к двум опциям: платить за проприетарные модели или жертвовать производительностью ради полной открытости. Gemma 4 E2B на «малинке» уже сегодня решает прикладные задачи — офлайн-транскрибацию, разметку данных, прототипирование интерфейсов. 26B MoE и 31B Dense дают прирост точности, но требуют соответствующей инфраструктуры. А лицензия Apache 2.0 делает весь пакет инструментом, а не просто пресс-релизом от вендора.